Einleitung: KI verändert die Spielanalyse

Die Champions League ist mehr als nur ein Fußballwettbewerb. Sie ist das jährliche Hochamt des europäischen Klubfußballs, ein Ort, an dem sich die besten Mannschaften des Kontinents messen und wo einzelne Abende zu unvergesslichen Momenten werden können. Wer erinnert sich nicht an das Wunder von Istanbul 2005, als Liverpool einen 0:3-Rückstand gegen den AC Mailand noch drehte? Oder an Manchester Uniteds zwei Treffer in der Nachspielzeit gegen Bayern München 1999? Solche Momente sind es, die den Fußball so faszinierend machen – und gleichzeitig so schwer vorherzusagen.

In der heutigen Zeit, in der Daten allgegenwärtig sind und Rechenleistung nahezu unbegrenzt verfügbar ist, stellt sich die Frage: Kann Technologie uns helfen, den Ausgang von Fußballspielen besser einzuschätzen? Die Antwort ist komplex, aber eines steht fest: Künstliche Intelligenz hat die Art und Weise, wie wir über Fußball denken und ihn analysieren, grundlegend verändert.

Doch genau hier hat sich in den vergangenen Jahren etwas Grundlegendes verändert. Während früher Experten ihre Prognosen auf Bauchgefühl, Erfahrung und vielleicht ein paar oberflächliche Statistiken stützten, hat die Künstliche Intelligenz mittlerweile Einzug in die Welt der Fußballanalyse gehalten. Algorithmen verarbeiten heute Datenmengen, die vor zehn Jahren noch undenkbar gewesen wären. Sie analysieren nicht nur, wie viele Tore eine Mannschaft geschossen hat, sondern auch, aus welchen Positionen diese Tore entstanden, wie hoch die Wahrscheinlichkeit jedes einzelnen Schusses war, und welche Muster sich über Wochen und Monate hinweg erkennen lassen.

Die AI Champions League Vorhersage ist dabei kein Blick in die Kristallkugel. Sie ersetzt nicht die Unberechenbarkeit des Spiels, aber sie gibt uns Werkzeuge an die Hand, mit denen wir die Wahrscheinlichkeiten besser einschätzen können. Wenn ein Supercomputer berechnet, dass Bayern München mit 67 Prozent Wahrscheinlichkeit gegen einen Gegner gewinnt, dann bedeutet das eben auch, dass in einem von drei Fällen etwas anderes passiert. Die KI eliminiert die Überraschung nicht – aber sie hilft uns, sie in einen größeren Kontext einzuordnen.

Für Fans, die einfach nur wissen wollen, wie die Chancen ihres Vereins stehen, bieten KI-Vorhersagen eine faszinierende zusätzliche Perspektive. Für diejenigen, die ihr Wissen bei Sportwetten einsetzen möchten, können sie ein wertvolles Hilfsmittel sein – vorausgesetzt, man versteht, wie sie funktionieren und wo ihre Grenzen liegen. Dieser Artikel erklärt beides. Er zeigt, welche Technologien hinter den Prognosen stecken, welche Daten die Algorithmen füttern und warum selbst die beste KI manchmal spektakulär daneben liegt. Denn genau das macht den Fußball ja auch so schön: Er lässt sich nie vollständig berechnen.

Was versteht man unter AI Champions League Vorhersage?

Bevor wir tiefer in die Materie einsteigen, sollten wir klären, was eine KI-Vorhersage eigentlich ist – und was sie nicht ist. Der Begriff wird heute inflationär verwendet. Jede zweite Webseite wirbt mit "AI-powered predictions", doch hinter diesem Etikett verbergen sich sehr unterschiedliche Ansätze. Manche Plattformen nutzen tatsächlich sophisticated Machine-Learning-Algorithmen, andere setzen lediglich einfache statistische Modelle ein und schmücken sich mit dem KI-Label, weil es modern klingt.

Eine echte KI-Vorhersage für die Champions League basiert auf maschinellem Lernen. Das bedeutet: Ein Algorithmus wird mit historischen Daten gefüttert – Spielergebnisse, Torschüsse, Ballbesitzwerte, Spielerpositionen, taktische Formationen und vieles mehr. Aus diesen Daten lernt das System, Muster zu erkennen. Es versteht beispielsweise, dass Mannschaften mit hohem Pressing gegen tiefstehende Gegner statistisch gesehen bestimmte Ergebnistypen produzieren, oder dass Teams nach europäischen Auswärtsspielen in der folgenden Ligapartie oft Punkte liegenlassen. Diese Muster sind für das menschliche Auge oft unsichtbar, weil sie in der schieren Masse der Daten untergehen. Die KI hingegen kann sie extrahieren und für Prognosen nutzen.

Der Unterschied zu traditionellen Expertenvorhersagen liegt nicht nur in der Datenmenge, sondern auch in der Objektivität. Ein menschlicher Analyst hat unvermeidlich Vorlieben, Abneigungen und kognitive Verzerrungen. Er überschätzt vielleicht die Bedeutung eines einzelnen spektakulären Spiels oder unterschätzt einen Underdog, weil er dessen Namen nicht kennt. Die KI hat solche emotionalen Anker nicht. Sie bewertet jeden Datenpunkt gleich, unabhängig davon, ob es um Real Madrid oder einen Debütanten aus einer kleineren Liga geht. Das macht sie nicht unfehlbar – aber es eliminiert zumindest eine Fehlerquelle.

Es gibt allerdings einen wichtigen Unterschied zwischen deterministischen und probabilistischen Vorhersagen, den man verstehen sollte. Eine deterministische Vorhersage sagt: "Bayern München wird gewinnen." Eine probabilistische Vorhersage sagt: "Bayern München gewinnt mit 72 Prozent Wahrscheinlichkeit, Unentschieden liegt bei 16 Prozent, eine Niederlage bei 12 Prozent." Seriöse KI-Systeme arbeiten ausschließlich probabilistisch, denn sie wissen um die Grenzen ihrer eigenen Berechenbarkeit. Wenn jemand behauptet, seine KI könne Spielausgänge mit Sicherheit vorhersagen, sollte man skeptisch werden. Der Fußball ist ein chaotisches System mit zu vielen Variablen, als dass absolute Gewissheit möglich wäre.

Der Grund für diese inhärente Unsicherheit liegt in der Natur des Spiels selbst. Fußball wird von 22 Menschen gespielt, die alle ihre eigenen Stärken, Schwächen, Tagesformen und mentalen Zustände haben. Dazu kommt ein Ball, dessen Flugbahn von Wind, Rasenbeschaffenheit und zahllosen anderen Faktoren beeinflusst wird. Schiedsrichterentscheidungen können Spiele kippen. Selbst die Wahl der Schuhe kann einen Unterschied machen. All diese Variablen in ein Modell zu integrieren ist schlicht unmöglich – und deshalb wird es immer eine Restungewissheit geben, die kein Algorithmus eliminieren kann.

Die besten KI-Systeme gehen noch einen Schritt weiter: Sie berechnen nicht nur Siegwahrscheinlichkeiten, sondern simulieren ganze Spiele tausendfach durch. Der Opta Supercomputer beispielsweise lässt jede Partie zehntausend Mal virtuell ablaufen, mit leicht variierten Ausgangsbedingungen. Am Ende steht dann nicht eine einzelne Prognose, sondern eine Verteilung von Ergebnissen: In 4.200 von 10.000 Simulationen gewann Team A, in 3.100 gab es ein Unentschieden, in 2.700 gewann Team B. Solche Zahlen sind ungleich aussagekräftiger als ein einfaches "Team A gewinnt".

Die Technologie hinter KI-gestützten Fußballprognosen

Wer verstehen will, wie KI-Vorhersagen entstehen, muss einen Blick unter die Motorhaube werfen. Die Technologie dahinter ist komplex, aber nicht unverständlich – und wer die Grundprinzipien kennt, kann die Qualität verschiedener Systeme besser einschätzen.

Am Anfang steht das maschinelle Lernen, ein Teilbereich der Künstlichen Intelligenz. Die Grundidee ist simpel: Anstatt einem Computer explizit zu sagen, wie er ein Problem lösen soll, gibt man ihm Daten und lässt ihn selbst herausfinden, welche Muster darin stecken. Im Kontext der Champions League bedeutet das: Man füttert ein System mit den Daten tausender vergangener Spiele – Ergebnisse, Statistiken, Kaderinformationen, taktische Daten – und lässt es lernen, welche Faktoren mit Siegen, Niederlagen und Unentschieden korrelieren.

Neuronale Netze

Die am häufigsten verwendeten Algorithmen lassen sich grob in drei Kategorien einteilen. Da wären zunächst die neuronalen Netze, die lose dem menschlichen Gehirn nachempfunden sind. Sie bestehen aus Schichten künstlicher Neuronen, die Informationen verarbeiten und weiterleiten. Tiefe neuronale Netze mit vielen Schichten – sogenanntes Deep Learning – können extrem komplexe Zusammenhänge erkennen, brauchen dafür aber auch sehr viele Trainingsdaten. Für die Champions League, wo pro Saison nur einige hundert Spiele stattfinden, ist das manchmal ein limitierender Faktor. Allerdings umgehen clevere Entwickler dieses Problem, indem sie ihre Modelle mit Daten aus nationalen Ligen vortrainieren und dann für den europäischen Wettbewerb feinabstimmen. Auf diese Weise lernt das System zunächst die grundlegenden Muster des Fußballs und spezialisiert sich anschließend auf die Besonderheiten der Königsklasse.

Ensemble-Methoden

Dann gibt es Ensemble-Methoden wie Random Forests oder Gradient Boosting. Diese Ansätze kombinieren viele einfache Modelle zu einem starken Gesamtmodell. Stellt man sich vor, man fragt hundert verschiedene Experten nach ihrer Meinung und bildet dann den Durchschnitt – so ähnlich funktionieren diese Algorithmen. Jeder einzelne "Baum" im "Wald" ist vielleicht nicht besonders klug, aber zusammen erreichen sie erstaunliche Trefferquoten.

Monte-Carlo-Simulationen

Schließlich sind da noch die Monte-Carlo-Simulationen, die besonders für Turniervorhersagen beliebt sind. Der Name stammt vom berühmten Casino – und tatsächlich geht es um Zufall. Die Methode simuliert ein Ereignis tausendfach, wobei jedes Mal leicht unterschiedliche Zufallselemente einfließen. Am Ende zählt man, wie oft welches Ergebnis eingetreten ist. Wenn Bayern München in 6.700 von 10.000 Simulationen das Achtelfinale erreicht, liegt die Wahrscheinlichkeit dafür bei 67 Prozent. Diese Methode ist besonders nützlich, weil sie die inhärente Unsicherheit des Fußballs explizit abbildet.

Was viele nicht wissen: Die eigentliche Kunst liegt nicht in der Wahl des Algorithmus, sondern in der Aufbereitung der Daten – dem sogenannten Feature Engineering. Welche Variablen sind wirklich relevant? Ist es wichtiger, wie viele Tore eine Mannschaft in den letzten fünf Spielen geschossen hat, oder wie viele hochkarätige Chancen sie kreiert hat? Sollte man die Heim-Auswärts-Bilanz einbeziehen? Die Anzahl der Tage seit dem letzten Spiel? Die Reisedistanz? Erfahrene Data Scientists verbringen oft mehr Zeit mit diesen Fragen als mit dem eigentlichen Modelltraining. Denn selbst die brillanteste KI kann nur das lernen, was man ihr zeigt. Füttert man sie mit den falschen Daten, produziert sie falsche Vorhersagen – egal wie sophisticated der Algorithmus ist.

Ein weiterer kritischer Punkt ist das Overfitting, ein Problem, das selbst erfahrenen Analysten passiert. Overfitting bedeutet, dass ein Modell die Trainingsdaten auswendig lernt, anstatt allgemeine Muster zu erkennen. Ein überangepasstes Modell könnte beispielsweise "lernen", dass Manchester United immer gewinnt, wenn es regnet und der Schiedsrichter aus Spanien kommt – einfach weil das in den historischen Daten zufällig ein paarmal vorkam. Solche Scheinkorrelationen führen zu katastrophalen Vorhersagen, sobald das Modell auf neue Daten trifft. Seriöse KI-Systeme verwenden deshalb aufwändige Validierungsmethoden, um Overfitting zu verhindern.

Datenquellen und Metriken: Woraus die KI ihre Schlüsse zieht

Eine KI ist nur so gut wie die Daten, mit denen sie gefüttert wird. Im Fußball hat sich die Datenverfügbarkeit in den vergangenen zehn Jahren revolutioniert. Während früher selbst Profivereine kaum mehr als Torschüsse und Ballbesitz erfassten, tracken moderne Analysesysteme heute jeden Meter, den ein Spieler auf dem Platz zurücklegt, jeden Pass, jeden Zweikampf, jeden Schuss – und berechnen daraus Dutzende abgeleiteter Metriken.

Die Grundlage bilden die klassischen Spielstatistiken: Tore, Assists, Schüsse, Schüsse aufs Tor, Ballbesitz, Passquote, Zweikampfquoten, Ecken, Fouls, Karten. Diese Zahlen sind leicht verfügbar und bilden das Fundament jeder Analyse. Doch für sich genommen erzählen sie oft nur die halbe Geschichte. Eine Mannschaft kann 70 Prozent Ballbesitz haben und trotzdem verlieren, wenn sie den Ball nur quer und zurück spielt. Zehn Torschüsse klingen imposant, bedeuten aber wenig, wenn neun davon harmlose Fernschüsse aus 30 Metern waren. Das Problem liegt in der fehlenden Kontextualisierung – eine Zahl ohne Einordnung ist oft irreführend.

Die Entwicklung fortgeschrittener Statistiken war deshalb ein entscheidender Schritt. Analysten erkannten früh, dass die reinen Ergebniszahlen zu stark vom Zufall abhängen. Ein Ball, der im Spiel zuvor noch den Pfosten traf, geht im nächsten vielleicht rein – ohne dass sich an der zugrundeliegenden Spielqualität irgendetwas geändert hätte. Die Suche nach stabileren, prädiktiveren Metriken führte zu einer ganzen Reihe neuer Kennzahlen, die heute zum Standardrepertoire gehören.

Deshalb arbeiten moderne KI-Systeme mit fortgeschritteneren Metriken. Expected Goals, kurz xG, ist dabei die wichtigste – darauf gehen wir im nächsten Abschnitt ausführlich ein. Aber es gibt noch viele weitere: Expected Assists (xA) misst, wie wahrscheinlich ein Pass zu einem Tor führt. Packing quantifiziert, wie viele Gegenspieler mit einem Pass überspielt wurden. Progressive Passes zählen Pässe, die den Ball signifikant nach vorne bringen. PPDA (Passes Allowed Per Defensive Action) misst die Pressingintensität. Jede dieser Metriken beleuchtet einen anderen Aspekt des Spiels.

Neben den spielbezogenen Daten fließen auch kontextuelle Informationen ein. Die Trainersituation spielt eine Rolle: Hat ein Team gerade den Coach gewechselt? Wie ist die historische Bilanz des Trainers in europäischen Wettbewerben? Verletzungen und Sperren sind offensichtlich relevant – fehlt der Stammtorwart, sinken die Chancen. Aber auch subtilere Faktoren werden berücksichtigt: Wie viele Kilometer hat eine Mannschaft in der laufenden Saison bereits zurückgelegt? Steht am Wochenende ein wichtiges Ligaspiel an, für das möglicherweise Kräfte geschont werden? Hat das Team eine englische Woche hinter sich?

Die Kaderqualität wird ebenfalls quantifiziert, häufig über Marktwerte. Die Datenbank von Transfermarkt, die Spielerwerte auf Basis verschiedener Faktoren schätzt, ist dabei eine wichtige Quelle. Die Korrelation zwischen Kaderwert und Erfolg ist im Fußball erstaunlich hoch – nicht perfekt, aber signifikant. Eine Verdopplung des Marktwerts bedeutet statistisch gesehen etwa zehn zusätzliche Ligapunkte pro Saison. Natürlich gibt es Ausnahmen, aber als ein Faktor unter vielen ist der Marktwert durchaus aussagekräftig.

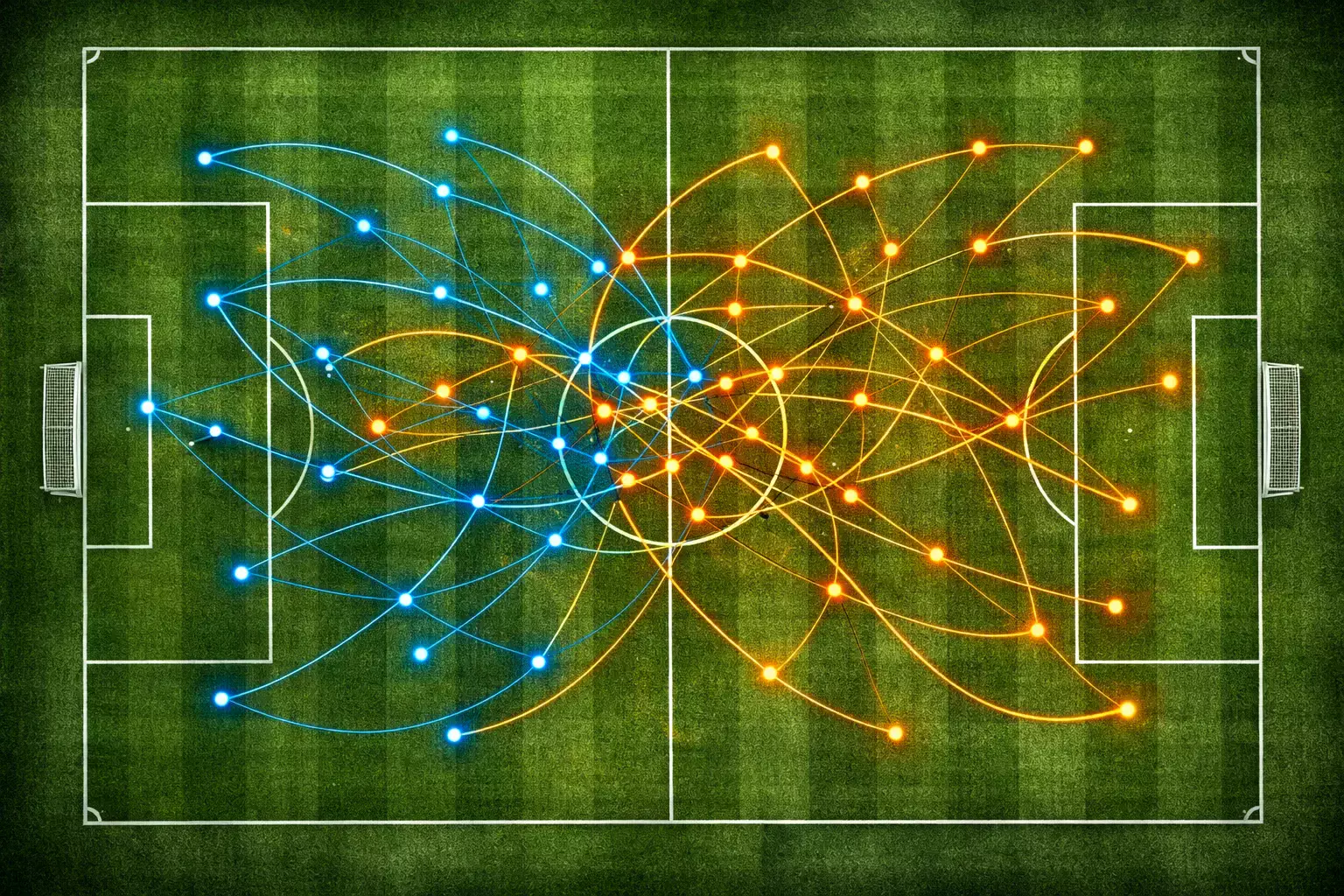

Besonders interessant wird es bei den taktischen Daten. Moderne Tracking-Systeme erfassen die Position jedes Spielers 25-mal pro Sekunde. Daraus lassen sich Formationen rekonstruieren, Pressing-Muster analysieren, Angriffswege visualisieren. Eine KI kann erkennen, dass Team A typischerweise über die linke Seite angreift, während Team B dort defensiv anfällig ist – eine Konstellation, die menschliche Analysten möglicherweise übersehen würden. Diese Detailtiefe war vor einem Jahrzehnt noch Science-Fiction.

Allerdings gibt es auch Grenzen der Quantifizierbarkeit. Wie misst man Motivation? Wie erfasst man die Atmosphäre in der Kabine? Der Wille eines Teams, das nach einem 0:2-Rückstand noch einmal aufsteht, lässt sich nicht in Zahlen gießen. Und genau hier liegt eine fundamentale Schwäche jeder datenbasierten Analyse: Sie kann nur verarbeiten, was messbar ist. Die ungreifbaren Aspekte des Fußballs – Leidenschaft, Nervenstärke, der berühmte Wille zum Sieg – bleiben außen vor. Deshalb sollte man KI-Vorhersagen niemals blind vertrauen, sondern sie als das sehen, was sie sind: eine quantitative Ergänzung zur qualitativen Einschätzung.

Expected Goals – Die Währung moderner Spielanalyse

Wenn es eine einzelne Metrik gibt, die die Fußballanalyse in den vergangenen Jahren revolutioniert hat, dann ist es Expected Goals, kurz xG. Der Wert ist mittlerweile so etabliert, dass er in Fernsehübertragungen eingeblendet wird und selbst Gelegenheitszuschauer damit konfrontiert werden. Doch was genau steckt dahinter, und warum ist xG für KI-Vorhersagen so wertvoll?

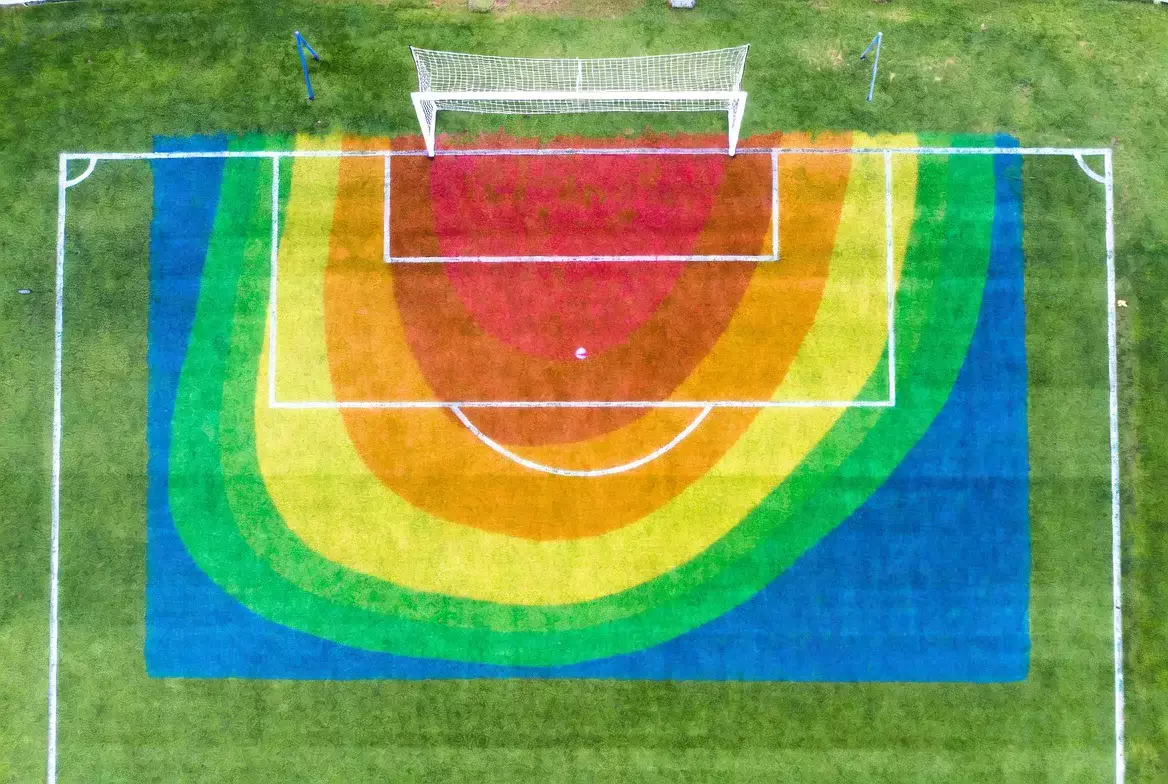

Die Grundidee ist bestechend einfach: Nicht jeder Torschuss ist gleich gefährlich. Ein Schuss aus fünf Metern direkt vor dem leeren Tor hat eine höhere Erfolgswahrscheinlichkeit als ein Fernschuss aus 30 Metern in einen dicht besiedelten Strafraum. xG quantifiziert diese Wahrscheinlichkeit. Auf Basis historischer Daten wird für jede Schusspositionen berechnet, wie oft aus vergleichbaren Situationen ein Tor gefallen ist. Ein xG-Wert von 0,75 bedeutet: Aus Schüssen dieser Art fallen statistisch gesehen 75 von 100 Toren. Das klingt zunächst abstrakt, wird aber sofort greifbar, wenn man es auf konkrete Spielsituationen anwendet.

Stellen wir uns vor, ein Stürmer bekommt den Ball nach einer Flanke am Fünfmeterraum, zentral vor dem Tor, ohne Verteidiger in unmittelbarer Nähe. Historisch gesehen führen solche Situationen in etwa 60 bis 70 Prozent der Fälle zu Toren – der xG-Wert liegt entsprechend hoch. Nimmt derselbe Spieler hingegen einen Distanzschuss aus 25 Metern, während drei Verteidiger den Weg zum Tor versperren, sinkt die Erfolgswahrscheinlichkeit auf vielleicht fünf Prozent. Über ein ganzes Spiel summiert sich xG zu einem aussagekräftigen Bild der Chancenqualität beider Teams.

Ein xG-Wert von 0,75 bedeutet: Aus Schüssen dieser Art fallen statistisch gesehen 75 von 100 Toren.

Die Berechnung berücksichtigt zahlreiche Faktoren. Die Distanz zum Tor ist der wichtigste, gefolgt vom Winkel. Ein zentraler Schuss aus zehn Metern hat einen höheren xG-Wert als ein Schuss aus spitzem Winkel von der Strafraumgrenze. Aber auch die Spielsituation fließt ein: Wurde der Schuss mit dem Kopf abgegeben oder mit dem Fuß? Kam der Ball aus einem Querpass, einem Steilpass oder einem Abpraller? Wie viele Verteidiger standen zwischen Schütze und Tor? War der Torwart in Position oder außerhalb seines Kastens? All diese Variablen beeinflussen die Erfolgswahrscheinlichkeit.

Für KI-Vorhersagen ist xG aus mehreren Gründen so wertvoll. Erstens ist es ein besserer Indikator für die tatsächliche Spielstärke als die erzielten Tore. Tore unterliegen erheblichen Zufallsschwankungen – manchmal fällt ein Fernschuss unhaltbar in den Winkel, manchmal trifft ein Elfmeter den Pfosten. xG glättet diese Zufälle, indem es die Chancenqualität misst, nicht das tatsächliche Ergebnis. Eine Mannschaft, die regelmäßig mehr xG produziert als sie Tore schießt, wird langfristig höchstwahrscheinlich mehr treffen. Eine Mannschaft, die über ihrer xG-Erwartung liegt, wird vermutlich zurückfallen.

Zweitens ermöglicht xG die Identifikation von Über- und Unterperformern. Wenn ein Team nach zehn Spieltagen 15 Tore bei einer xG-Summe von 10 hat, performt es deutlich über Erwartung. Das kann an einem überragenden Stürmer liegen, der auch schwierige Chancen verwandelt – oder an Glück, das irgendwann aufgebraucht sein wird. KI-Systeme nutzen solche Diskrepanzen für ihre Prognosen. Sie wissen, dass Regression zur Mitte ein mächtiges statistisches Prinzip ist: Extreme Werte tendieren dazu, sich dem Durchschnitt anzunähern.

Drittens lässt sich xG gut mit anderen Metriken kombinieren. xGA (Expected Goals Against) misst, wie viele Tore eine Mannschaft hätte kassieren müssen basierend auf den zugelassenen Chancen. Die Differenz aus xG und xGA ergibt die xG-Differenz, einen hervorragenden Indikator für die Gesamtstärke eines Teams. In der Champions League, wo jedes Tor zählt und die Stichprobengrößen klein sind, ist die xG-Differenz oft aussagekräftiger als die tatsächliche Tordifferenz.

Es gibt allerdings auch Kritik an xG, die man kennen sollte. Das Modell erfasst nicht die Qualität des Schützen. Wenn Erling Haaland aus zehn Metern abzieht, ist die reale Erfolgswahrscheinlichkeit höher als bei einem durchschnittlichen Erstligastürmer – aber das Standard-xG-Modell behandelt beide gleich. Einige Anbieter haben deshalb Post-Shot-xG entwickelt, das zusätzlich die Schussplatzierung berücksichtigt. Außerdem ignoriert xG alle Situationen, die nicht in einem Schuss münden: vergebene Großchancen, bei denen der Ball vor dem Abschluss verloren ging, oder brillante Einzelaktionen, die am letzten Verteidiger scheiterten. Trotz dieser Einschränkungen bleibt xG die nützlichste fortgeschrittene Metrik im Fußball – und ein unverzichtbarer Bestandteil jeder ernsthaften KI-Vorhersage.

Der Opta Supercomputer und andere KI-Systeme im Vergleich

Wer sich mit KI-Vorhersagen für die Champions League beschäftigt, stößt unweigerlich auf verschiedene Systeme und Plattformen. Die bekannteste ist vermutlich der Opta Supercomputer, der regelmäßig in Medienberichten zitiert wird. Aber es gibt noch viele andere Ansätze, und nicht alle sind gleich verlässlich. Ein kritischer Blick auf die Landschaft hilft, die Spreu vom Weizen zu trennen.

Der Opta Supercomputer ist ein Produkt von Stats Perform, einem der führenden Sportdatenunternehmen der Welt. Opta sammelt seit Jahrzehnten detaillierte Spieldaten und hat eines der umfangreichsten Archive des Profifußballs aufgebaut. Der Supercomputer nutzt diese Daten für Monte-Carlo-Simulationen: Er lässt jedes Spiel zehntausend Mal virtuell ablaufen und berechnet aus den Ergebnissen Wahrscheinlichkeiten. Die Stärke des Systems liegt in der Datenqualität und der Transparenz – Opta kommuniziert offen, wie die Prognosen zustande kommen, und veröffentlicht regelmäßig Updates zur historischen Trefferquote. Das unterscheidet seriöse Anbieter von jenen, die ihre Methodik im Dunkeln lassen und mit vagen Versprechungen werben.

Die Infrastruktur hinter solchen Systemen ist beeindruckend. Opta beschäftigt Hunderte von Datenanalysten weltweit, die jedes Spiel der großen Ligen in Echtzeit erfassen. Jeder Pass, jede Ballberührung, jede Spielerposition wird dokumentiert. Diese Rohdaten fließen in zentrale Datenbanken, wo sie aufbereitet, validiert und für die Algorithmen zugänglich gemacht werden. Der Aufwand ist enorm, aber er erklärt auch, warum die Prognosen von Opta eine gewisse Autorität genießen – sie basieren auf dem wohl umfassendsten Datensatz der Fußballwelt.

In Deutschland hat sich BETSiE einen Namen gemacht, das KI-System der Plattform Wettbasis. BETSiE analysiert Champions-League-Spiele mit einem eigenen Algorithmus und berechnet nicht nur Siegwahrscheinlichkeiten, sondern auch erwartete Torwerte und Value-Einschätzungen für verschiedene Wettmärkte. Die Stärke liegt hier in der Kombination aus KI-Analyse und redaktioneller Einordnung – die Rohdaten werden von Experten kommentiert und kontextualisiert.

Plattformen wie Forebet oder Predicd bieten kostenlose KI-Vorhersagen für ein breites Publikum. Ihre Algorithmen sind weniger transparent als die von Opta, liefern aber durchaus brauchbare Ergebnisse. Der Nachteil kostenloser Dienste liegt oft in der Update-Frequenz: Während kommerzielle Systeme Prognosen in Echtzeit aktualisieren, wenn sich die Nachrichtenlage ändert, reagieren Gratisangebote manchmal verzögert auf kurzfristige Entwicklungen wie Verletzungen oder Aufstellungsänderungen.

Dann gibt es noch die Sprachmodelle wie ChatGPT, die zunehmend für Sportprognosen genutzt werden. Hier ist Vorsicht geboten. Große Sprachmodelle sind beeindruckende Werkzeuge, aber sie sind nicht für quantitative Vorhersagen optimiert. Sie können keine echten Simulationen durchführen und haben keinen Echtzeitzugriff auf aktuelle Daten. Wenn ChatGPT eine Champions-League-Vorhersage ausspuckt, basiert diese bestenfalls auf allgemeinem Wissen und groben Einschätzungen – nicht auf der datengetriebenen Analyse, die echte Vorhersagesysteme auszeichnet.

Wie schneiden diese Systeme im Vergleich ab? Seriöse Anbieter veröffentlichen ihre historischen Trefferquoten. Für den klassischen Drei-Wege-Markt (Sieg, Unentschieden, Niederlage) erreichen die besten Systeme Quoten zwischen 50 und 55 Prozent. Das mag auf den ersten Blick wenig beeindruckend klingen, ist aber deutlich besser als Zufall (33 Prozent) und kann bei richtiger Anwendung langfristig profitabel sein. Bei anderen Märkten wie Über/Unter-Wetten liegen die Trefferquoten oft noch höher, teilweise bei 60 bis 65 Prozent.

Allerdings sollte man Trefferquoten mit Vorsicht interpretieren. Eine hohe Quote nützt wenig, wenn die Vorhersagen keine Informationen liefern, die über das allgemein Bekannte hinausgehen. Wenn eine KI vorhersagt, dass Bayern München gegen einen luxemburgischen Zweitligisten gewinnt, mag das stimmen – aber es ist keine Erkenntnis, für die man Algorithmen braucht. Der wahre Test für ein Vorhersagesystem ist, ob es in Situationen mit unsicherem Ausgang besser performt als der Zufall oder die Buchmacherquoten.

Wie KI die Champions League 2025/26 einschätzt

Die aktuelle Champions-League-Saison bietet reichlich Material für KI-Analysen. Das neue Format mit der Ligaphase – einer gemeinsamen Tabelle aller 36 Teilnehmer statt der früheren Gruppenphase – hat die Vorhersagen komplexer, aber auch spannender gemacht. Jedes Team absolviert acht Spiele gegen acht verschiedene Gegner, und am Ende qualifizieren sich die besten 24 für die K.o.-Runde. Die Algorithmen hatten einiges zu tun, um ihre Modelle anzupassen. Das alte Format mit festgelegten Gruppen war leichter zu simulieren, weil die Konstellationen überschaubar waren. Die neue Ligaphase mit ihren 36 Teilnehmern und den daraus resultierenden Verflechtungen erfordert deutlich mehr Rechenleistung und sophistiziertere Modellierung.

Für die KI-Entwickler war die Formatumstellung eine willkommene Herausforderung. Die größere Stichprobe – acht statt sechs Spiele pro Team in der Vorrunde – liefert mehr Datenpunkte und macht die Prognosen tendenziell robuster. Gleichzeitig sind die Unsicherheiten größer, weil die Playoff-Runde zwischen den Plätzen 9 und 24 eine zusätzliche Variable einführt. Teams, die sich erst über die Playoffs qualifizieren, haben mehr Spiele in den Beinen – ein Faktor, der in den späteren Runden durchaus eine Rolle spielen kann.

Nach den bisherigen Spieltagen zeichnet sich ein interessantes Bild ab. Der Opta Supercomputer sieht aktuell Arsenal als Favoriten auf den Titel, vor Liverpool und Paris Saint-Germain. Das ist bemerkenswert, denn Arsenal hat den Henkelpott noch nie gewonnen – das letzte und einzige Finale erreichten die Gunners 2006, als sie gegen Barcelona verloren. Die hohe Einstufung basiert auf der Kadertiefe, den Investitionen des vergangenen Sommers und der statistischen Performance in der laufenden Saison.

Die deutschen Teilnehmer werden unterschiedlich bewertet. Der FC Bayern München gilt nach wie vor als ernsthafter Anwärter, auch wenn die Mannschaft in dieser Saison bisher nicht immer überzeugen konnte. Die KI-Systeme sehen den Rekordmeister auf einem komfortablen Weg ins Achtelfinale, mit einer hohen Wahrscheinlichkeit, die Top Acht der Ligaphase zu erreichen und damit die Playoff-Runde zu überspringen. Die xG-Daten zeigen allerdings, dass Bayern defensiv anfälliger ist als in vergangenen Jahren – ein Warnsignal für die K.o.-Spiele.

Borussia Dortmund bewegt sich laut Prognosen im Mittelfeld der Erwartungen. Die Mannschaft hat das Potenzial für Überraschungen, wie das Finale 2024 bewies, aber die Konstanz fehlt. Die Algorithmen rechnen mit einem Weiterkommen, sehen den BVB aber eher als Außenseiter für die späteren Runden. Interessant ist, dass die xG-Differenz des BVB in der Champions League historisch besser ist als in der Bundesliga – europäische Nächte scheinen der Mannschaft zu liegen.

Bayer Leverkusen, der amtierende deutsche Meister, hat die KI-Systeme vor eine interessante Aufgabe gestellt. Die Mannschaft von Xabi Alonso spielt einen statistisch ungewöhnlichen Fußball, der schwer zu modellieren ist. Die außergewöhnlich niedrige Anzahl an Gegentoren bei gleichzeitig moderater xGA deutet auf eine überdurchschnittliche defensive Organisation hin, die nicht vollständig in den Standardmetriken erfasst wird. Die meisten Systeme sehen Leverkusen als sicheren Kandidaten für die K.o.-Phase, mit Außenseiterchancen auf mehr.

Eintracht Frankfurt schließlich kämpft nach den bisherigen Ergebnissen um das Weiterkommen. Die Prognosen sind hier volatiler als bei den anderen deutschen Teams, weil die Stichprobengröße klein ist und die SGE gegen starke Gegner auf dem Papier Außenseiter bleibt. Die KI sieht Frankfurt knapp in den Playoffs, aber ein frühes Ausscheiden ist nicht ausgeschlossen.

Was diese Einschätzungen wert sind, wird sich zeigen. Die Geschichte der Champions League ist voll von Momenten, in denen die Statistik versagte. Leicester City gewann 2016 die englische Meisterschaft mit einer Quote von 5.000 zu 1 – jede KI hätte das als praktisch unmöglich eingestuft. Aber genau das macht den Fußball ja auch so faszinierend: Er respektiert die Wahrscheinlichkeiten, aber er beugt sich ihnen nicht. Die größten Geschichten des Sports werden oft gerade dann geschrieben, wenn das Unwahrscheinliche eintritt.

In der Champions League selbst gibt es zahllose Beispiele für solche Überraschungen. Griechenland gewann 2004 die Europameisterschaft gegen alle Prognosen. Chelsea holte 2012 den Henkelpott unter Umständen, die statistisch kaum erklärbar sind – sie wurden in der K.o.-Runde mehrfach outplayed, setzten sich aber trotzdem durch. Solche Ereignisse sind keine Widerlegung der KI-Analyse, sondern vielmehr eine Erinnerung daran, dass Wahrscheinlichkeiten keine Gewissheiten sind. Eine 90-prozentige Chance bedeutet eben auch, dass in einem von zehn Fällen das Gegenteil passiert.

Grenzen und Schwächen von KI-Vorhersagen

Wer KI-Vorhersagen nutzen will, sollte ihre Grenzen kennen. Denn so beeindruckend die Technologie auch ist – sie hat blinde Flecken, und wer diese ignoriert, wird früher oder später böse Überraschungen erleben. Die Geschichte des Fußballs ist voll von Momenten, in denen alle Statistiken versagten, weil etwas Unberechenbares geschah. Das zu verstehen ist nicht nur wichtig für die realistische Einschätzung von Prognosen, sondern auch für das Verständnis dessen, was den Fußball so faszinierend macht.

Die offensichtlichste Grenze liegt in der Unvorhersehbarkeit einzelner Ereignisse. Eine KI kann berechnen, dass Team A mit 70 Prozent Wahrscheinlichkeit gewinnt. Was sie nicht vorhersagen kann, ist, dass der Starspieler von Team A in der dritten Minute mit einer Muskelverletzung ausscheidet. Oder dass der Schiedsrichter eine fragwürdige Rote Karte zeigt. Oder dass es zu einem Platzsturm kommt und das Spiel abgebrochen wird. Solche Ereignisse sind selten, aber wenn sie eintreten, werden alle statistischen Modelle über den Haufen geworfen. Man denke nur an das Halbfinale 2019, als Tottenham in der Nachspielzeit gegen Ajax noch den Einzug ins Finale schaffte – ein Szenario, das Minuten vorher praktisch ausgeschlossen schien.

Weniger offensichtlich, aber nicht weniger wichtig, ist das Problem der Datenerfassung. KI-Systeme können nur verarbeiten, was gemessen wird. Wie motiviert ist eine Mannschaft? Wie ist die Stimmung in der Kabine? Hat der Trainer die richtigen taktischen Anpassungen gefunden? Hat der Kapitän in der Pause eine feurige Ansprache gehalten? All das sind Faktoren, die Spiele entscheiden können – aber sie tauchen in keiner Statistik auf. Die beste KI der Welt kann die Magie nicht erfassen, die entsteht, wenn ein Team über sich hinauswächst.

Dann gibt es das Problem der kleinen Stichproben. In einer Bundesligasaison spielt jede Mannschaft 34 Ligaspiele – genug Daten, um aussagekräftige Statistiken zu berechnen. In der Champions League sind es pro Team nur acht bis fünfzehn Partien, je nachdem, wie weit man kommt. Statistische Analysen werden bei solch kleinen Zahlen unzuverlässig. Ein Torwart, der in drei CL-Spielen alle Schüsse hält, mag überragend sein – oder er hatte einfach drei glückliche Abende. Die KI kann das nicht unterscheiden.

Ein weiterer Schwachpunkt sind sogenannte Black-Swan-Ereignisse: seltene, unvorhersehbare Vorkommnisse mit großen Auswirkungen. Das Istanbul-Finale 2005 war ein solches Ereignis. Kein Algorithmus der Welt hätte prognostiziert, dass Liverpool nach 0:3 noch zurückkommt. Solche Spiele sind statistisch so unwahrscheinlich, dass sie in normalen Modellen nicht vorkommen – aber im echten Fußball passieren sie eben doch. Und genau diese Momente sind es oft, die in Erinnerung bleiben.

Schließlich muss man das Problem der sich selbst erfüllenden oder selbst zerstörenden Prognosen bedenken. Wenn eine KI vorhersagt, dass ein Team als Favorit in ein Spiel geht, könnte das die Motivation des Underdogs steigern und die Überheblichkeit des Favoriten fördern. Die Vorhersage beeinflusst also das, was sie vorhersagen soll. Im Wettmarkt ist das Phänomen noch deutlicher: Wenn viele Menschen einer KI-Prognose folgen und auf ein bestimmtes Ergebnis setzen, verschieben sich die Quoten – und die vermeintliche Value-Wette ist plötzlich keine mehr.

All das bedeutet nicht, dass KI-Vorhersagen nutzlos sind. Sie bedeuten aber, dass man sie mit gesunder Skepsis betrachten sollte. Die beste Verwendung von KI-Prognosen ist nicht, ihnen blind zu folgen, sondern sie als eine Informationsquelle unter vielen zu nutzen. Sie können helfen, eigene Einschätzungen zu hinterfragen, blinde Flecken aufzudecken und unbeachtete Zusammenhänge zu erkennen. Aber die finale Entscheidung – ob man ein Spiel schaut, mit wem man fiebert oder worauf man wettet – sollte immer eine menschliche bleiben.

KI-Prognosen richtig nutzen: Ein Leitfaden

Nachdem wir die Technologie, die Daten und die Grenzen besprochen haben, stellt sich die praktische Frage: Wie nutzt man KI-Vorhersagen am besten? Hier sind einige Prinzipien, die sich in der Praxis bewährt haben. Sie gelten gleichermaßen für Fans, die einfach ein besseres Verständnis für die Chancen ihres Teams entwickeln wollen, wie für jene, die ihr Wissen bei Sportwetten einsetzen möchten.

Das wichtigste Prinzip ist die Quellenvielfalt. Verlassen Sie sich nie auf ein einzelnes System. Unterschiedliche KI-Anbieter nutzen unterschiedliche Methoden, Datenquellen und Gewichtungen. Wenn Opta, BETSiE und Forebet alle dasselbe Ergebnis für wahrscheinlich halten, ist das ein stärkeres Signal als die Prognose einer einzelnen Plattform. Divergierende Einschätzungen sind ebenfalls wertvoll – sie zeigen, dass ein Spiel schwer zu prognostizieren ist und Vorsicht geboten ist. Ein erfahrener Analyst behandelt Konsens als Bestätigung und Dissens als Warnsignal.

Zweitens sollte man Wahrscheinlichkeiten als das nehmen, was sie sind. Wenn eine KI sagt, Team A gewinnt mit 65 Prozent Wahrscheinlichkeit, dann bedeutet das: In ungefähr einem von drei Fällen passiert etwas anderes. Das ist keine Schwäche des Modells, sondern eine ehrliche Einschätzung der Unsicherheit. Wer auf Basis dieser Prognose wettet und verliert, sollte das Ergebnis nicht als Beweis dafür sehen, dass die KI versagt hat. Auch eine 35-Prozent-Wahrscheinlichkeit bedeutet, dass das Ereignis regelmäßig eintritt.

Drittens lohnt sich die Kombination aus KI-Daten und eigenem Wissen. Die Algorithmen sind gut darin, quantitative Muster zu erkennen – aber sie verstehen den Fußball nicht wirklich. Wenn Sie wissen, dass der Schlüsselspieler von Team B gerade Vater geworden ist und wahrscheinlich emotional aufgeladen spielen wird, ist das eine Information, die keine Statistik erfasst. Nutzen Sie die KI als Ausgangspunkt, aber ergänzen Sie sie um Ihr eigenes Kontextwissen.

Viertens ist Timing wichtig. KI-Prognosen ändern sich, wenn neue Informationen verfügbar werden. Eine Vorhersage vom Montag für ein Spiel am Mittwoch berücksichtigt nicht die Trainingsberichte vom Dienstag. Wer auf Basis von KI-Daten Entscheidungen trifft – etwa für Sportwetten – sollte möglichst aktuelle Prognosen nutzen und sie kurz vor dem Spiel noch einmal überprüfen.

Fünftens und letztens: Vergessen Sie nie den Unterhaltungswert. Die Champions League ist ein Spektakel, das man genießen sollte. KI-Vorhersagen können das Erlebnis bereichern, indem sie neue Perspektiven eröffnen und zum Nachdenken anregen. Aber sie sollten den Spaß nicht ersetzen. Manchmal ist das schönste am Fußball, dass er uns überrascht – und keine KI der Welt sollte uns diese Freude nehmen.

Häufig gestellte Fragen

Wie funktioniert eine KI-basierte Champions League Vorhersage?

Eine KI-Vorhersage für die Champions League entsteht durch die Analyse umfangreicher historischer und aktueller Daten. Machine-Learning-Algorithmen werden mit Informationen zu Spielergebnissen, Torschüssen, xG-Werten, Ballbesitzstatistiken, Spielerformen und taktischen Mustern gefüttert. Das System lernt aus vergangenen Spielen, welche Faktoren mit Siegen, Niederlagen und Unentschieden korrelieren. Anschließend führt es oft tausende Simulationen durch, um Wahrscheinlichkeiten für verschiedene Spielausgänge zu berechnen. Anders als ein menschlicher Experte hat die KI keine emotionalen Vorlieben und kann Datenmengen verarbeiten, die für Menschen nicht handhabbar wären. Das Ergebnis sind probabilistische Aussagen wie "Team A gewinnt mit 62 Prozent Wahrscheinlichkeit", die die inhärente Unsicherheit des Fußballs widerspiegeln.

Wie hoch ist die Trefferquote von KI-Prognosen bei Champions League Spielen?

Die Trefferquote hängt vom betrachteten Markt und vom verwendeten System ab. Für den klassischen Drei-Wege-Markt (Sieg, Unentschieden, Niederlage) erreichen führende KI-Systeme wie der Opta Supercomputer Trefferquoten zwischen 48 und 55 Prozent. Das ist signifikant besser als der Zufallswert von 33 Prozent, aber weit entfernt von Perfektion. Bei weniger volatilen Märkten wie Über/Unter-Wetten liegen die Quoten oft höher, teilweise bei 60 bis 65 Prozent. Wichtig ist: Eine Trefferquote allein sagt wenig aus. Entscheidend ist, ob die Prognosen Informationen liefern, die über die Buchmacherquoten hinausgehen – also echten "Value" bieten. Die besten KI-Systeme identifizieren systematisch Situationen, in denen die statistisch ermittelte Wahrscheinlichkeit von der marktimpliziten Wahrscheinlichkeit abweicht.

Welche Rolle spielt xG bei KI-gestützten Fußballvorhersagen?

Expected Goals (xG) ist eine der wichtigsten Metriken für moderne KI-Systeme. Der Wert misst die Qualität von Torchancen basierend auf Position, Winkel, Spielsituation und historischen Erfolgsraten vergleichbarer Schüsse. Für Vorhersagen ist xG wertvoller als die tatsächlich erzielten Tore, weil es weniger von Zufall beeinflusst ist. Eine Mannschaft, die konstant mehr xG produziert als Tore schießt, wird diese Differenz langfristig ausgleichen – ein statistisches Prinzip namens Regression zur Mitte. KI-Systeme nutzen xG auch zur Identifikation von Über- und Unterperformern: Teams, die deutlich über ihrer xG-Erwartung scoren, werden wahrscheinlich zurückfallen. Die xG-Differenz (xG erzielt minus xG zugelassen) ist einer der besten Prädiktoren für zukünftigen Erfolg in der Champions League.